Video-Fakes werden besser

„Deep Video Portraits“ vermeiden Fehler, an denen man DeepFakes erkennen konnte

Eine neue KI tauscht so täuschend echt Gesichter in Videos aus, dass selbst achtsame Nutzer die Manipulation nicht mehr erkennen. Dahinter verbirgt sich kein Durchbruch der KI-Forschung, sondern Vorverarbeitung mit viel menschlicher Intelligenz.

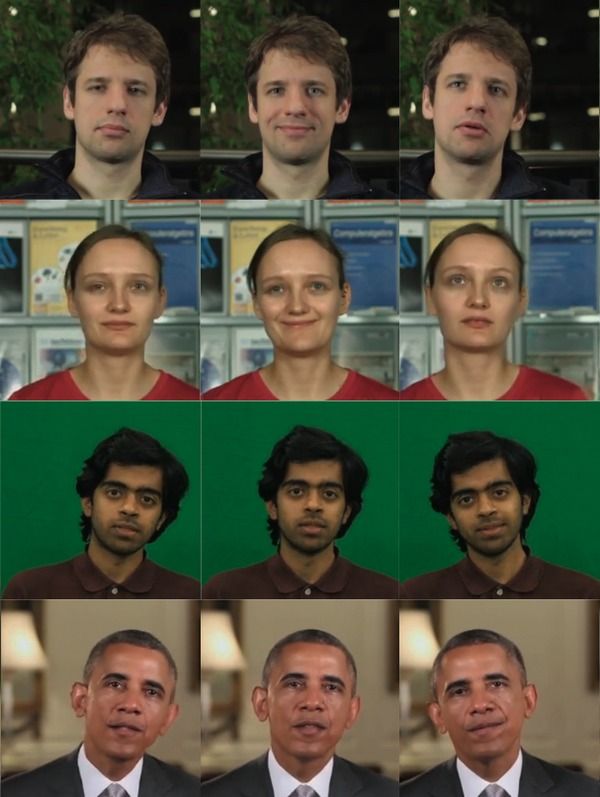

Seit DeepFakes [1] sollte man bei Videos genau hinschauen, ob nicht eine KI die Gesichter ausgetauscht hat. Das wird jetzt noch schwieriger, denn ein für die diesjährige Siggraph-Konferenz vorgestelltes Verfahren berechnet so überzeugende Fälschungen, dass laut einer Nutzerstudie jeder Zweite auf die Fakes hereinfällt. Wenn man bedenkt, dass ein Fünftel der offenbar kritischen Probanden auch die unbearbeiteten Videos für Fälschungen hielt, ist das eine ganze Menge.

Um im Vergleich zu früheren Verfahren noch überzeugender Gesichter auszutauschen, programmierten die Forscher einiges an menschlichem Vorwissen in ihren Algorithmus: Der passt nämlich zuerst ein aus 3D-Scans erzeugtes Gesichtsmodell an die Form, Textur, Mimik, Kopfdrehung und Beleuchtungssituation des Quell- und Zielgesichts an. Die Forscher können nun nach Belieben Parameter von einem Gesicht auf das andere übertragen, beispielsweise die Mimik oder die Kopfdrehung. Mit diesem 3D-Modell lässt sich leicht ein Farbbild des Gesichts berechnen. Dem fehlt aber der Hintergrund. Außerdem wirkt es wie eine Figur aus einem Computerspiel.

Die eigentliche KI berechnet nun aus dem Rendering ein fotorealistisches Bild und erfindet einen passenden Hintergrund. Die KI geht dabei grundsätzlich wie DeepFakes vor, verwendet aber mehr Schichten mit zusätzlichen Neuronen. Ein zweites neuronales Netz hilft beim Training, indem es versucht, Fälschungen von Originalen zu unterscheiden. Außerdem berücksichtigt das Bilder malende neuronale Netz zehn vorhergehende Videobilder, wodurch das getauschte Gesicht seltener zuckt oder springt.

Der Aufwand zum Erzeugen dieser Fälschungen ist allerdings ziemlich hoch. Statt für selbst gefälschte Promi-Pornos wie bei DeepFakes eignen sich Deep Video Portraits daher eher für Filmeffekte. Beispielsweise kann man damit Filme so überarbeiten, dass die Lippenbewegungen eines Schauspielers zu denen des Synchronsprechers passen. (pmk@ct.de)

Beispielvideo:ct.de/yg99